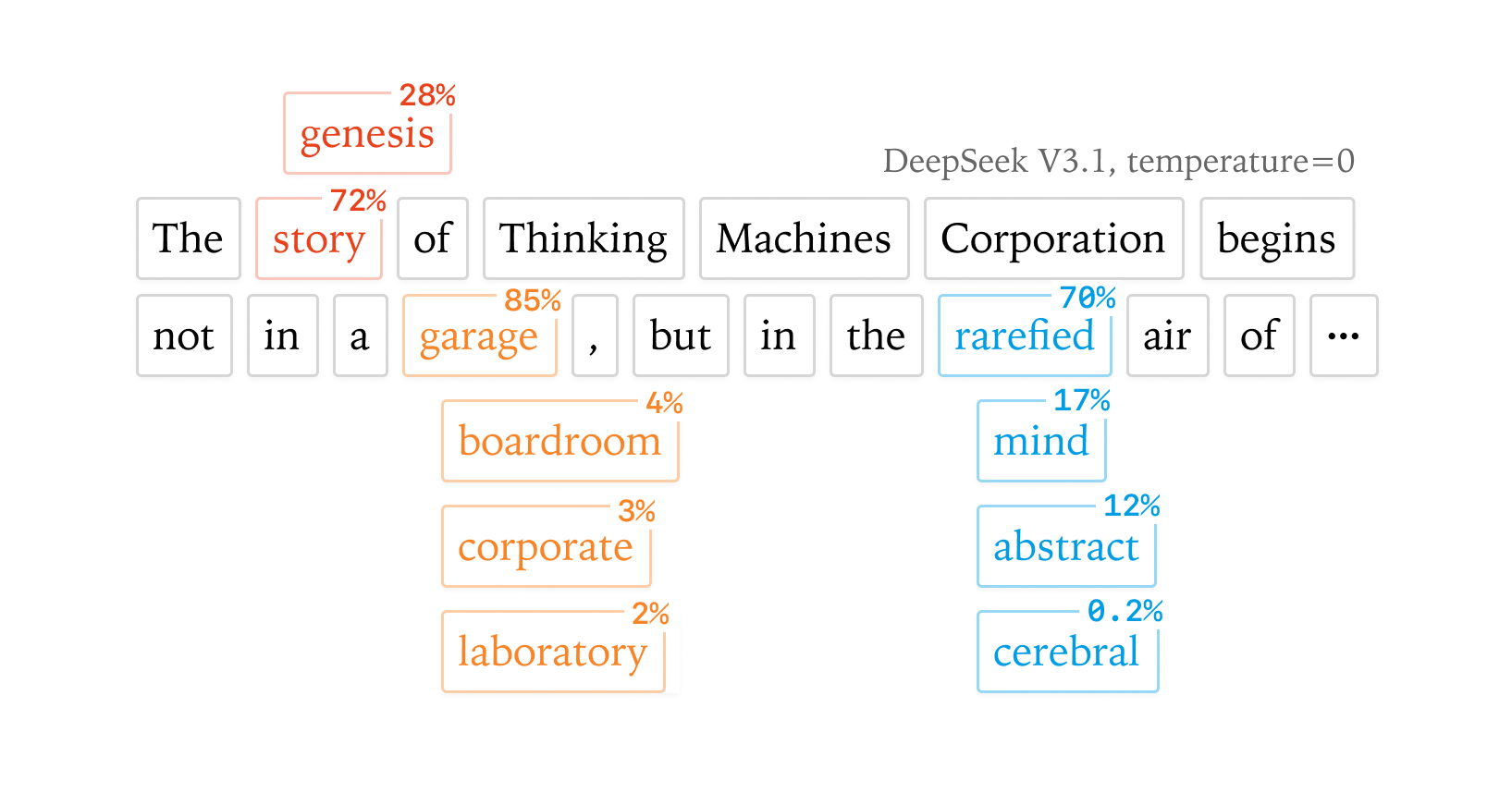

A natureza probabilística dos grandes modelos de linguagem dificulta a reprodutibilidade de resultados, mesmo em condições de temperatura zero.

A busca pela reprodutibilidade em grandes modelos de linguagem (LLMs) tem encontrado barreiras técnicas significativas. Embora a definição de temperatura zero seja comumente utilizada para tentar forçar um comportamento determinístico, a natureza probabilística da geração de tokens faz com que as respostas variem entre execuções. Esse fenômeno ocorre tanto em serviços de API de larga escala quanto em implementações de infraestrutura própria, comprometendo a confiabilidade necessária para aplicações científicas e de engenharia. O problema se estende a bibliotecas populares de inferência, como vLLM e SGLang, que ainda enfrentam dificuldades para garantir consistência absoluta. A falta de determinismo representa um desafio crítico para o desenvolvimento de sistemas baseados em IA, uma vez que a variabilidade nas saídas dificulta a depuração, a auditoria de modelos e a validação de resultados em ambientes de produção.

11 mai, 20:35

29 abr, 14:07

23 abr, 06:04

10 mar, 16:03

22 set, 21:00

Carregando comentários...