Superando a Indeterminismo na Inferência de LLMs

O artigo explora os desafios técnicos para alcançar a reprodutibilidade e o determinismo na inferência de grandes modelos de linguagem, mesmo sob condições de amostragem gananciosa.

|

09/09 às 21:00

Pontos principais

- A reprodutibilidade é fundamental para o progresso científico, mas apresenta dificuldades significativas em grandes modelos de linguagem (LLMs).

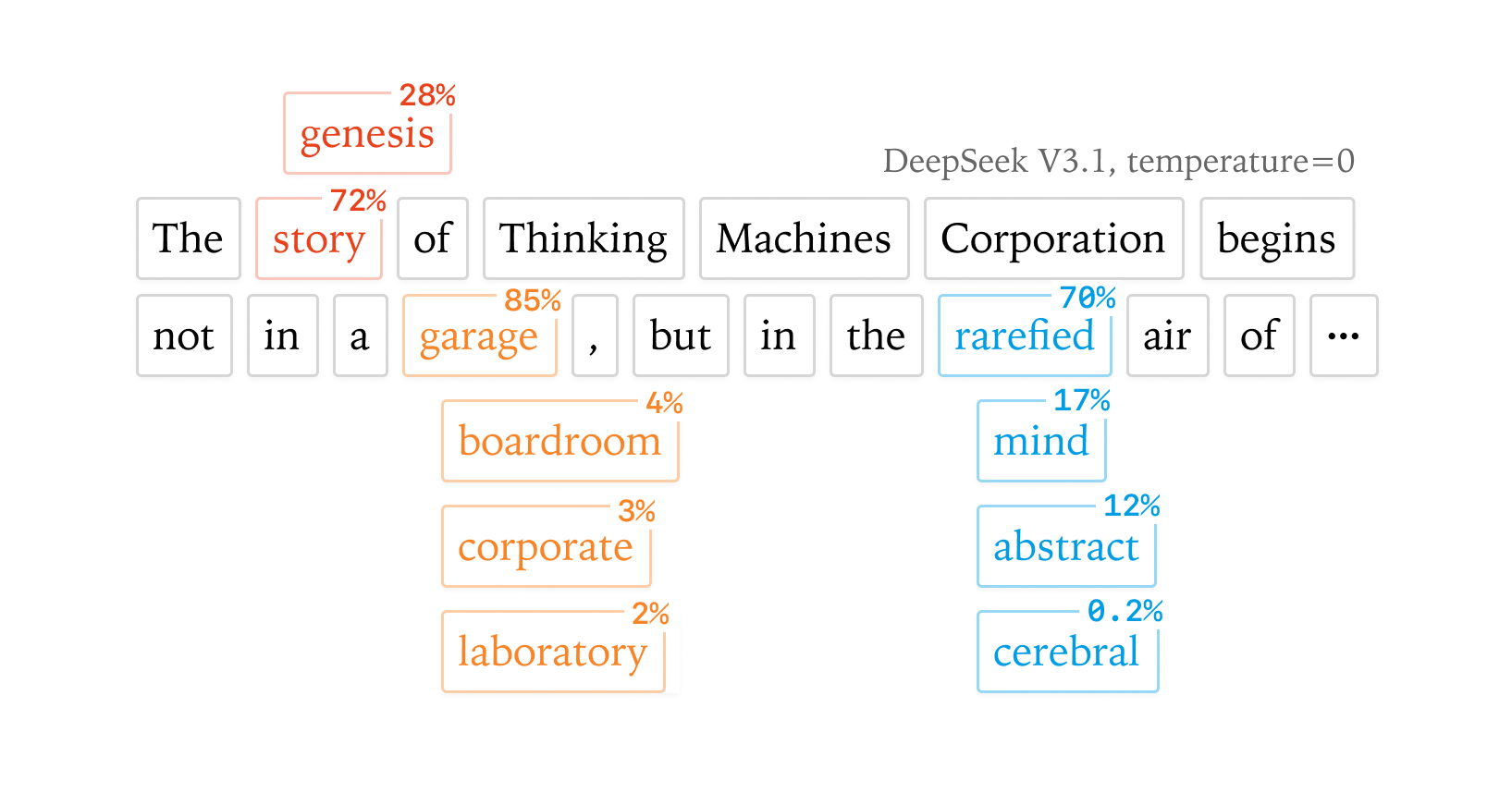

- A natureza probabilística da amostragem de tokens torna as respostas dos modelos variáveis por padrão.

- Mesmo com a temperatura definida como zero, a inferência em APIs de LLMs frequentemente falha em ser determinística na prática.

- Bibliotecas de inferência de código aberto, como vLLM e SGLang, também enfrentam desafios para garantir resultados consistentes em diferentes execuções.

- O problema da falta de determinismo persiste tanto em serviços de API quanto em implementações de hardware próprio.

Mencionado nesta matéria

Organizações

ChatGPTvLLMSGLang