Técnica de adaptação de baixo posto mantém desempenho comparável ao treinamento completo com maior eficiência computacional.

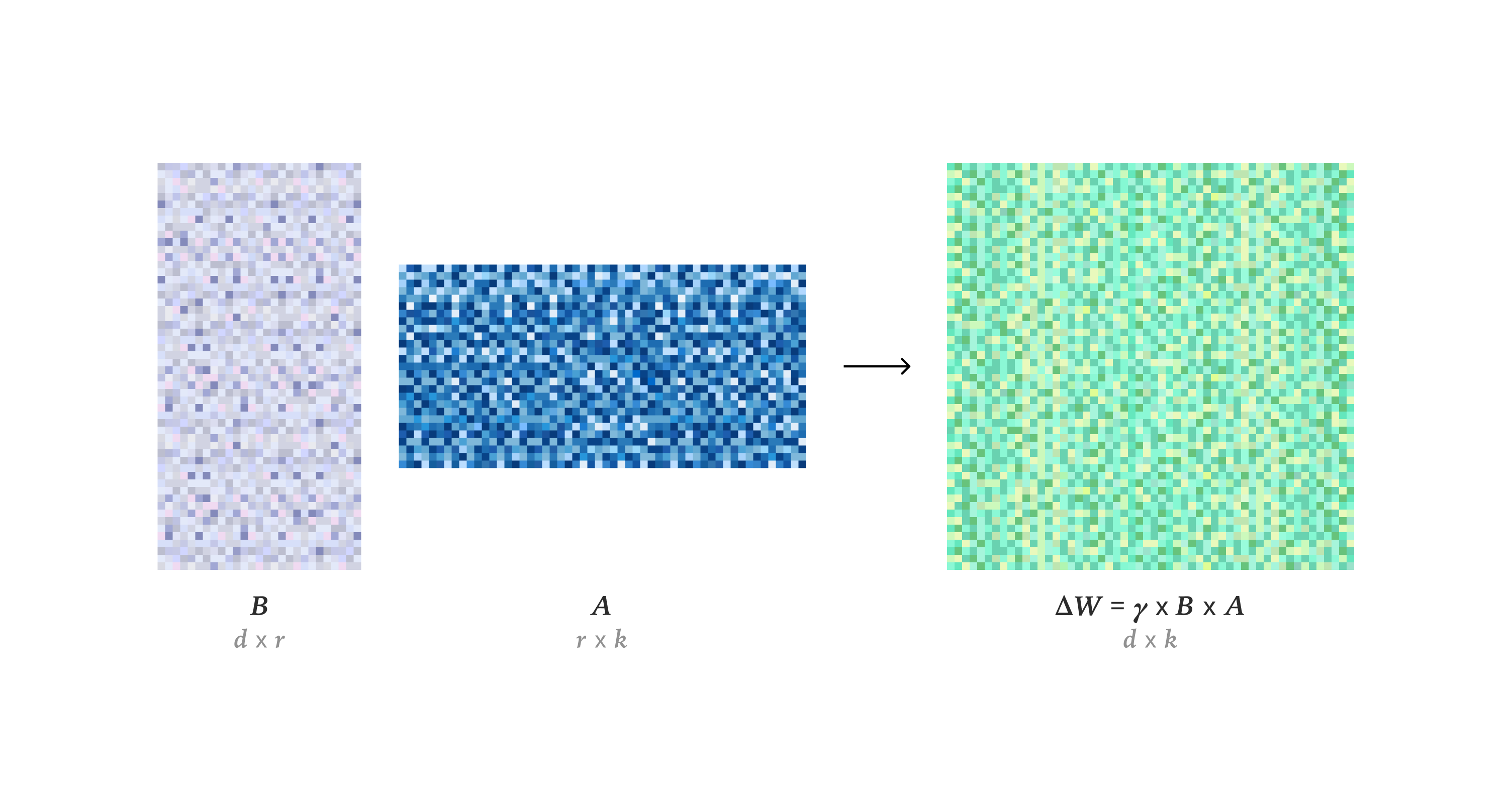

Uma nova análise técnica sobre a técnica Low-Rank Adaptation (LoRA) revelou que o método consegue manter um desempenho comparável ao treinamento completo de modelos de inteligência artificial em uma variedade maior de cenários do que se previa anteriormente. Ao focar na adaptação de baixo posto, o LoRA permite que desenvolvedores ajustem grandes modelos com uma fração dos recursos computacionais, tornando o processo mais acessível e econômico. A pesquisa destaca que a técnica não apenas preserva a performance em diferentes arquiteturas de redes neurais, mas também oferece uma versatilidade prática essencial para o desenvolvimento atual de sistemas de machine learning. Essa eficiência é um fator determinante para a escalabilidade de modelos complexos, permitindo que empresas e pesquisadores otimizem seus fluxos de trabalho sem comprometer a qualidade dos resultados finais.

7 mai, 18:38

7 mai, 00:02

6 mai, 04:04

23 abr, 12:02

18 mar, 09:00

Carregando comentários...